OpenAI - 新しい埋め込みモデルとAPIアップデートを発表

2024年1月25日のOpenAI公式リリースにて様々な開発者向けAPIアップデートがアナウンスされました。公式の翻訳を中心にお届けします。

新しい埋め込みモデルとAPIアップデート

・新世代の埋め込みモデル

・新しいGPT-4 Turboとモデレーションモデル

・新しいAPI使用管理ツール

・GPT-3.5 Turboの低価格化が開始されました

製品情報:新モデルのリリース

新しいモデルをリリースし、GPT-3.5 Turboの価格を下げ、開発者がAPIキーを管理し、APIの使用状況を把握するための新しい方法を導入します。新しいモデルは以下の通りです。

・2つの新しい埋め込みモデル

・GPT-4 Turboプレビューモデルの更新

・更新されたGPT-3.5 Turboモデル

・更新されたテキストモデレーションモデル

・デフォルトで、OpenAI APIに送信されたデータはOpenAIモデルのトレーニングや改良には使用されなくなります

価格を抑えた新しい埋め込みモデル

2つの新しい埋め込みモデルがリリースされます。

小さくて非常に効率的な text-embedding-3-small モデルと、大きくてより強力な text-embedding-3-large モデルです。

埋め込み(embedding; エンベッディング)とは、自然言語やコードなどのコンテンツ内の概念を表す数列のことです。埋め込みモデルは、機械学習モデルやその他のアルゴリズムがコンテンツ間の関係を理解し、クラスタリングや検索などのタスクを実行することを容易にします。エンベッディングは、ChatGPTとAssistants APIの知識検索のようなアプリケーションや、多くの検索拡張世代(RAG)開発者ツールに力を与えます。

新しい小さなテキスト埋め込みモデル

text-embedding-3-smallは、OpenAIの新しい高効率埋め込みモデルであり、2022年12月にリリースされた前身であるtext-embedding-ada-002モデルよりも大幅なアップグレードを提供します。

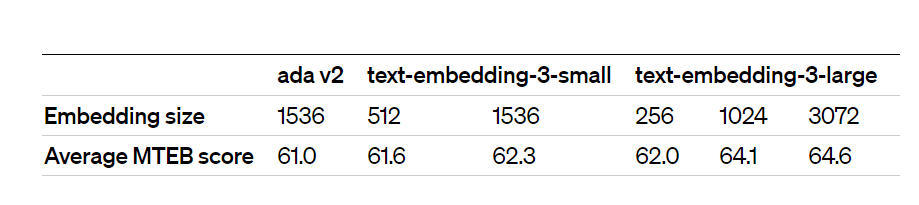

より強力なパフォーマンス text-embedding-ada-002とtext-embedding-3-smallを比較すると、多言語検索でよく使われるベンチマーク(MIRACL)の平均スコアは31.4%から44.0%に、英語タスクでよく使われるベンチマーク(MTEB)の平均スコアは61.0%から62.3%に向上しているとのこと。

text-embedding-3-smallは、前世代のtext-embedding-ada-002モデルよりも大幅に効率化されています。そのため、text-embedding-3-smallの価格は、text-embedding-ada-002に比べて5倍引き下げられ、1kトークンあたりの価格は0.0001ドルから0.00002ドルになりました。

OpenAIはtext-embedding-ada-002を非推奨としていません(not deprecating)ので、ユーザーは前世代のモデルを使い続けることができます(OpenAIは新しいモデルをお勧めしています)。

新しい大きなテキスト埋め込みモデル: text-embedding-3-large

text-embedding-3-largeは、次世代の大型埋め込みモデルで、最大3072次元までの埋め込みが可能です。

より強力なパフォーマンス:text-embedding-3-largeは、OpenAIの新しいベストパフォーマンスモデルです。text-embedding-ada-002とtext-embedding-3-largeを比較すると、MIRACLでは平均スコアが31.4%から54.9%に、MTEBでは平均スコアが61.0%から64.6%に向上しています。

text-embedding-3-largeの価格は$0.00013 / 1kトークンとなります。

新しい埋め込みモデルの使い方については、埋め込みガイドをご覧ください。

エンベッディングの短縮のネイティブサポート

より大きなエンベッディングを使用する場合、例えばそれらを検索するためにベクターストア(vector store)に保存する場合、一般的に、より小さなエンベッディングを使用するよりも、より多くのコストと、より多くの計算、メモリ、ストレージを消費します。OpenAIの新しい埋め込みモデルは、どちらもテクニック「Matryoshka Representation Learning」で学習されました。

マトリョーシカ表現学習により、開発者は埋め込みを使用する際の性能とコストをトレードオフすることができます。具体的には、開発者はdimensions APIパラメータを渡すことで、埋め込みが概念を表現する特性を失うことなく、埋め込みを短くすることができます。

例えばMTEBベンチマークでは、text-embedding-3-largeエンベッディングを256サイズに短縮しても、1536サイズの未短縮text-embedding-ada-002エンベッディングを上回ります。

これにより、非常に柔軟な使い方が可能になります。例えば、1024次元までの埋め込みしかサポートしていないベクトルデータストアを使用する場合でも、開発者は最適な埋め込みモデルtext-embedding-3-largeを使用し、dimensions APIパラメータに1024を指定することで、3072次元の埋め込みを短縮することができます。

その他の新モデルと低価格化

GPT-3.5 Turboモデルの更新と低価格化

来週、GPT-3.5 Turboの新モデル、gpt-3.5-turbo-0125を発表します。また、過去1年間で3度目となるGPT-3.5 Turboの価格引き下げを行い、スケールアップを支援します。新モデルのインプット価格は50%引き下げられ、1Kトークンあたり0.0005ドルに、アウトプット価格は25%引き下げられ、1Kトークンあたり0.0015ドルになります。このモデルはまた、要求されたフォーマットでの応答精度の向上や、英語以外の言語の関数呼び出しでテキストエンコーディングの問題を引き起こしていたバグの修正など、さまざまな改良が施されます。

ピン留めされた(pinned) gpt-3.5-turboモデルのエイリアスを使用しているお客様は、このモデルの発売の2週間後にgpt-3.5-turbo-0613からgpt-3.5-turbo-0125に自動的にアップグレードされます。

訳注:2024/1/25から2週間後、つまり2024/2/8に gpt-3.5-turbo-0613は turbo-0125に自動的に移行されるというように読めます。function callingの動作についても変わる可能性があると考えます。

GPT-4 Turboプレビューを更新

リリース以来、GPT-4 APIユーザーからのリクエストの70%以上がGPT-4 Turboに移行しています。

本日、更新されたGPT-4 Turboプレビュー・モデル、gpt-4-0125-previewをリリースします。このモデルは、以前のプレビューモデルよりもコード生成などのタスクを徹底的に完了させ、モデルがタスクを完了しない「怠慢(laziness)」なケースを減らすことを目的としています。新しいモデルには、英語以外のUTF-8世代に影響するバグの修正も含まれています。

新しいGPT-4 Turboプレビューバージョンに自動的にアップグレードされたい方のために、新しく gpt-4-turbo-preview というモデル名のエイリアスを導入します。

今後数ヶ月のうちに、GPT-4 Turbo with visionの一般提供を開始する予定です。

モデレーションモデルの更新

無料のモデレーションAPIにより、開発者は潜在的に有害なテキストを特定することができます。現在進行中の安全対策の一環として、これまでで最も堅牢なモデレーションモデルであるtext-moderation-007をリリースします。text-moderation-latestとtext-moderation-stableのエイリアスは、これを指すように更新されました。安全なAIシステムの構築については、安全ベストプラクティスガイドをご覧ください。

APIの使用状況を把握し、APIキーを管理する新しい方法

開発者がAPIキーの使用状況をより把握し、管理できるようにするため、2つのプラットフォームの改善を開始されました。

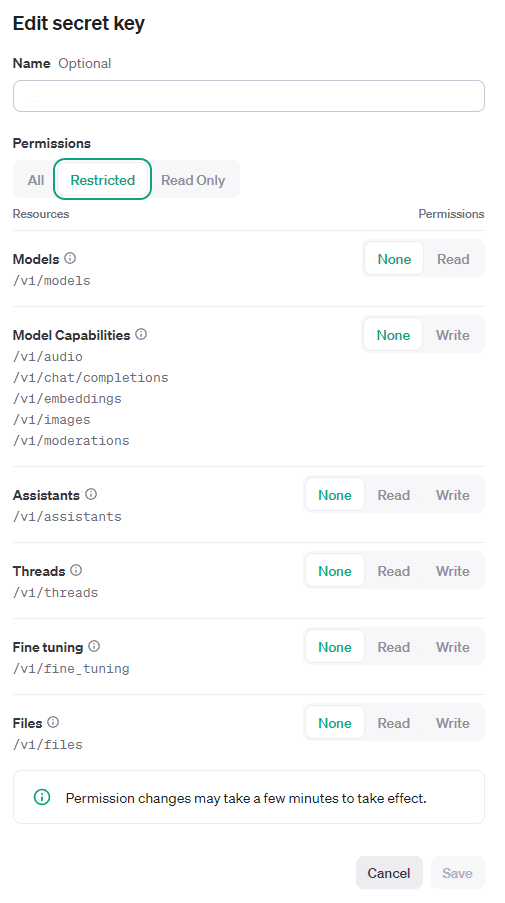

第一に、開発者はAPIキーのページからAPIキーに権限を割り当てることができるようになりました。例えば、内部トラッキングダッシュボードをパワーアップするために、キーに読み取り専用アクセスを割り当てたり、特定のエンドポイントにのみアクセスできるように制限したりすることができます。

第二に、利用状況ダッシュボードと利用状況エクスポート機能は、トラッキングをオンにした後、APIキーレベルでのメトリクスを公開するようになりました。これにより、機能ごと、チームごと、製品ごと、プロジェクトごとに別々のAPIキーを持つだけで、簡単に利用状況を見ることができます。

今後数ヶ月の間に、開発者がAPIの使用状況を見たり、APIキーを管理したりする機能をさらに改善する予定です。

AICU media 編集部のコメント

最後に紹介されていたAPIダッシュボードにおける「Usage」は期待されていた機能です。

https://platform.openai.com/usage

特に右上のキーごとの使用状況がわかることはとても重要です。今まではすべてのAPIキー全体での使用の合計しかわかりませんでした(各セッションの記録を調べる以外の方法がなかった)。裏APIなどもあったようですが、決済やコスト管理に必要なことなので、公式であることが大事です。

また権限設定についても確認してみました。

モデルの読み書き権限について、細く設定ができます。

GPT-3.5-turboの変化に要注意

訳注で記載した通り、gpt-3.5-turboは2024年2月8日に gpt-3.5-turbo-0613が gpt-3.5-turbo-0125に自動的に移行されるとアナウンスされています。function callingの動作についても変わる可能性があるようなので、事前に移行準備を進めておいたほうが良さそうです。

以上、開発者向けの情報でした!楽しいChatGPT開発ライフを!

いいなと思ったら応援しよう!